编辑 | 萝卜皮

将功能性磁共振成像 (fMRI) 信号解码为文本一直是神经科学界面临的一项重大挑战,它有望推动脑机接口的发展,并加深对大脑机制的了解。然而,现有的方法往往存在预测性能不佳、任务种类有限以及跨受试者泛化能力较差等问题。

针对这一问题,耶鲁大学(Yale University)、达特茅斯学院(Dartmouth College)和剑桥大学(University of Cambridge)的研究人员提出了 MindLLM,一种专为主题无关且用途广泛的 fMRI 到文本解码而设计的模型。

此外,研究人员提出了一种新方法——大脑指令调整 (BIT),可增强模型从 fMRI 信号中捕获不同语义表示的能力,从而促进更通用的解码。

在全面的 fMRI 到文本基准上的评估中, MindLLM 优于基线,下游任务提高了 12.0%,未知主题泛化提高了 16.4%,新任务适应提高了 25.0%。此外,MindLLM 中的注意力模式为其决策过程提供了可解释的见解。

该研究以「MindLLM: A Subject-Agnostic and Versatile Model for fMRI-to-Text Decoding」为题,于 2025 年 2 月 18 日发布在 arXiv 预印平台。

解码人类大脑活动(fMRI)为文本在神经科学领域引起了广泛关注。这一技术不仅为认知、行为和意识研究提供了新视角,还具有重要的社会应用价值。

例如,它可以帮助语言障碍者恢复沟通能力,使他们能够轻松表达思想;同时,它还能实现健康人群对数字设备(如具身 AI 或假肢)的神经控制,使操作更加直观和精确。

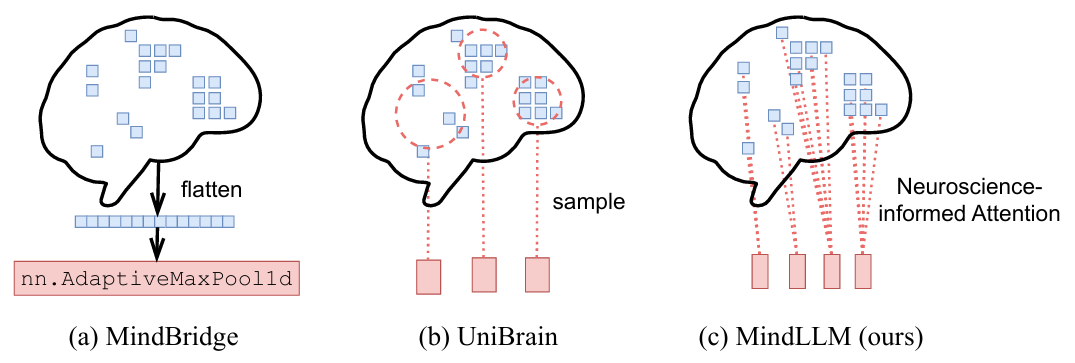

然而,该技术仍面临重大挑战:一是需要针对不同应用场景开发多功能解码模型,现有方法如 UMBRAE 虽能映射 fMRI 数据到刺激图像,但无法处理更广泛的任务(如记忆检索);二是缺乏统一且不依赖个体的解码架构,当前方法依赖预处理选择响应体素,导致输入维度不一致和空间信息丢失,影响性能。

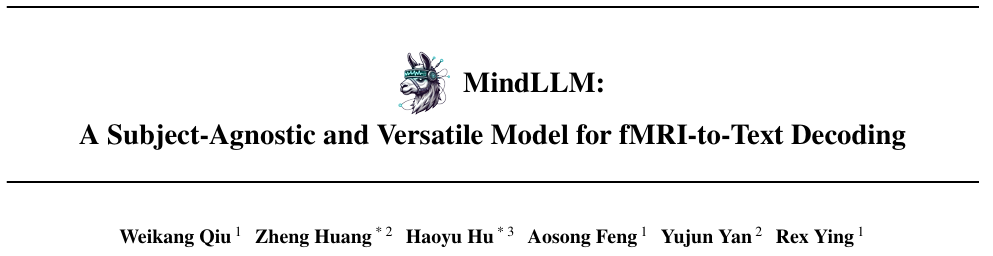

研究人员提出了 MindLLM,一种用于 fMRI 到文本解码的主题无关且通用的模型。该方法包括一个主题无关的 fMRI 编码器和一个现成的 LLM。

图示:MindLLM 概述。(来源:论文)

主题无关的 fMRI 编码器将神经科学信息注意层与可学习查询相结合,通过利用体素的空间信息和神经科学先验来实现动态特征提取,从而显著提高预测准确性。值和键的设计将体素的功能信息(在个体之间基本一致)与其 fMRI 值分开,从而使模型能够受益于跨主体共享的先验,并增强对新主体的概括性。

为了应对多功能解码的挑战,研究人员提出了脑指令调整(BIT)。BIT 使用以图像为中介的多样化数据集来训练模型,涵盖旨在捕获 fMRI 数据中编码的语义信息的不同方面的任务,包括感知和场景理解、记忆和知识检索、语言和符号处理以及复杂推理。

图示:我们的模型与之前的统一模型的比较。(来源:论文)

研究人员在综合基准上评估了 MindLLM。结果表明,它的表现优于基线,在各种下游任务中平均提高了 12.0%,在未见过的主题上的泛化提高了 16.4%。

MindLLM 能够有效地适应新任务,在实际应用中表现出很高的可定制性和灵活性。此外,对注意力权重的分析为该团队 fMRI 编码器的工作机制提供了宝贵的见解。

论文链接:https://arxiv.org/abs/2502.15786

相关报道:https://medicalxpress.com/news/2025-02-brain-imaging-text-mindllm.html

津公网安备12011002023007号

津公网安备12011002023007号