所谓AI幻觉,说人话就是:大数据模型一本正经地给你胡说八道,但是由于其输出过程过于有条理有逻辑,且表述过程中甚至不惜引经据典,加上“AI很强”的外部氛围,导致你一不留神,就会误以为真——其实通篇都在扯淡。

AI幻觉这玩意儿不是新鲜事,早在ChatGPT刚推出时已经有了“很多”讨论,后面到了o4、o1以及现在最新的o3,一方面是症状减轻了,另一方面是因为我们已经积累了足够多的、与ChatGPT斗智斗勇的经验了——不停地在Google做fact-checking,一遍又一遍地跟它argue。

但,我确实低估了两件事:

1. ChatGPT的高门槛。如果你要流畅订阅ChatGPT Plus,你甚至有一张香港银行卡都不行,因为Open AI在香港未开通付费服务。过去几个月我帮助了好几位朋友开通ChatGPT Plus订阅,很多朋友都是老网民了,依然搞不定,其门槛真的高得离谱。

2. 与之相比,从春节前开始爆发的,因为deepseek之低门槛、免费、人人可用(甚至我给爸妈手机都装上了,跟他们说这是baidu最新款 emmm,以后不用百度用这个),其在简中的普及程度并非ChatGPT可比。也因为deepseek之免费,许多用户是以休闲、体验、分享的心态来使用,而非我身边的自媒体从业者,愿意一个月给美帝20刀购买ChatGPT订阅——因为这是吃饭的家伙,所以会不停地总结工具的使用心得,锻炼出强劲的fact-checking经验。

3. 当然,也是因为deepseek在中文本地化的语境中,打造出了一套更适合中国国情的表达方式,中文表达更优于ChatGPT;“逻辑正确,答案也正确”,这种潜移默化的思维(如果你在大厂上过班,你一定会修炼出所谓的,通过一份ppt,把一团垃圾的结果,汇报成一场伟大战役的功夫),我们理科至上、文科生靠边站的思维,使得人稍不留神就中招。

最终的结果,就是deepseek生成了大量的、天马行空的谬误。这些谬误,严重地污染了简体中文互联网(而本身deepseek在信源引用上,跟ChatGPT相比,确实做得不如)。

今日公众号上看到一篇《比ChatGPT危险100倍!DeepSeek正在中文互联网建造“幻觉长城”》,好家伙,幻觉都变长城了,好文章。感兴趣可以看看。

如今在小红书上,可以刷到无数deepseek生成的帖子,前阵子我看到一个很有代表性,叫做《我听了这么多年五月天,还不如deepseek》,大概是让deepseek说说五月天音乐里的彩蛋:这里面全特么是扯几把蛋,但是评论区里都是大呼小叫,我留言了一句:我说你们就不能自己去查查看吗?没人理我。

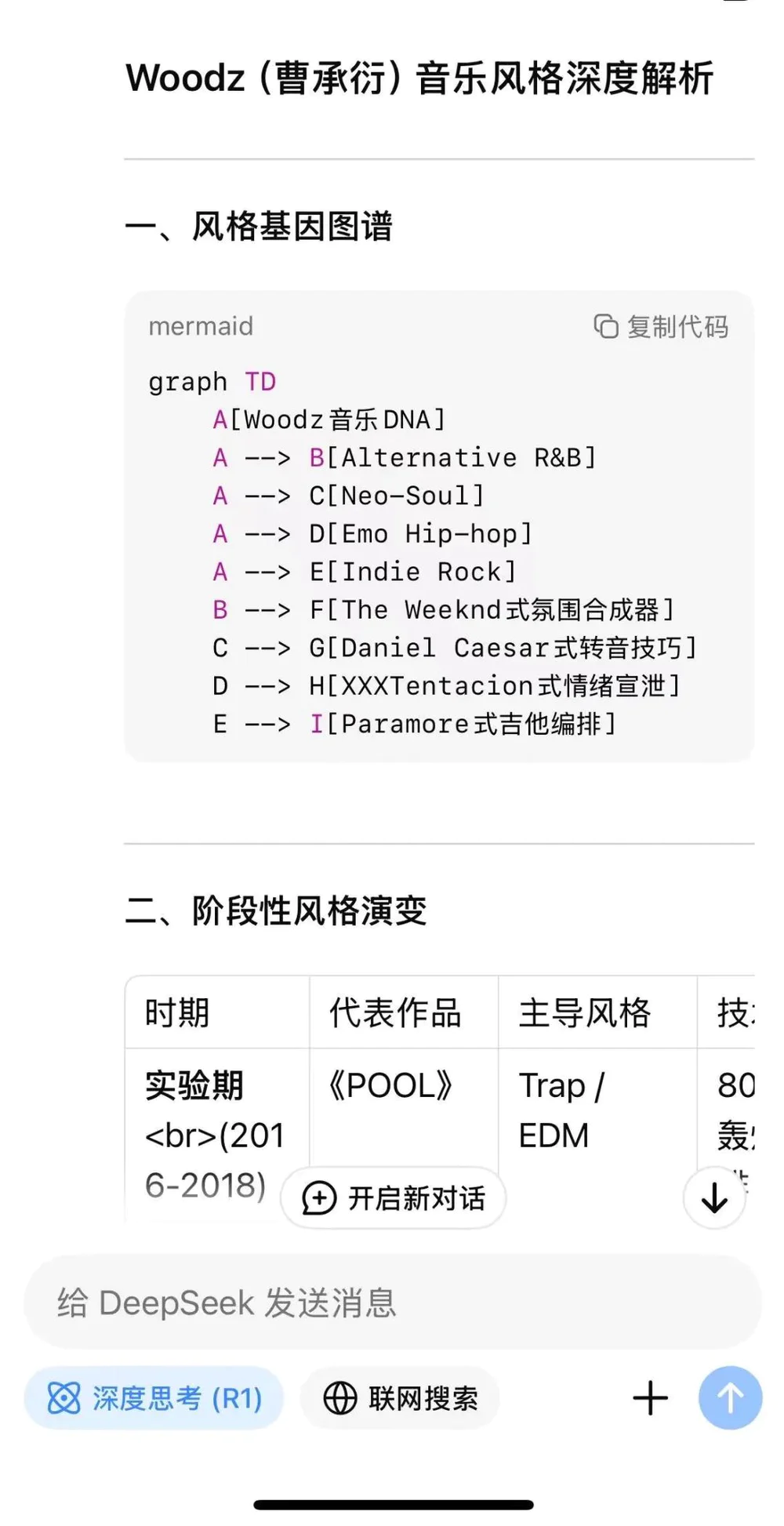

两周前我的朋友红老师也在第一时间试用了deepseek之后给我发来贺电,分享了她和deepseek讨论她的爱豆woodz的音乐风格、路线、趋势,因为我晓得deepseek对音乐文本的无能,所以本能反应也是——这特么的一眼假啊。逻辑没问题,但是这里面的论据、信源都是扯淡的啊。它本义就是一个大数据生成(搜索)模型,如果本身信源是不存在的,它能怎么得知呢?

我就随便点开红老师发给我的图:随便进去一首歌吧,这里说:

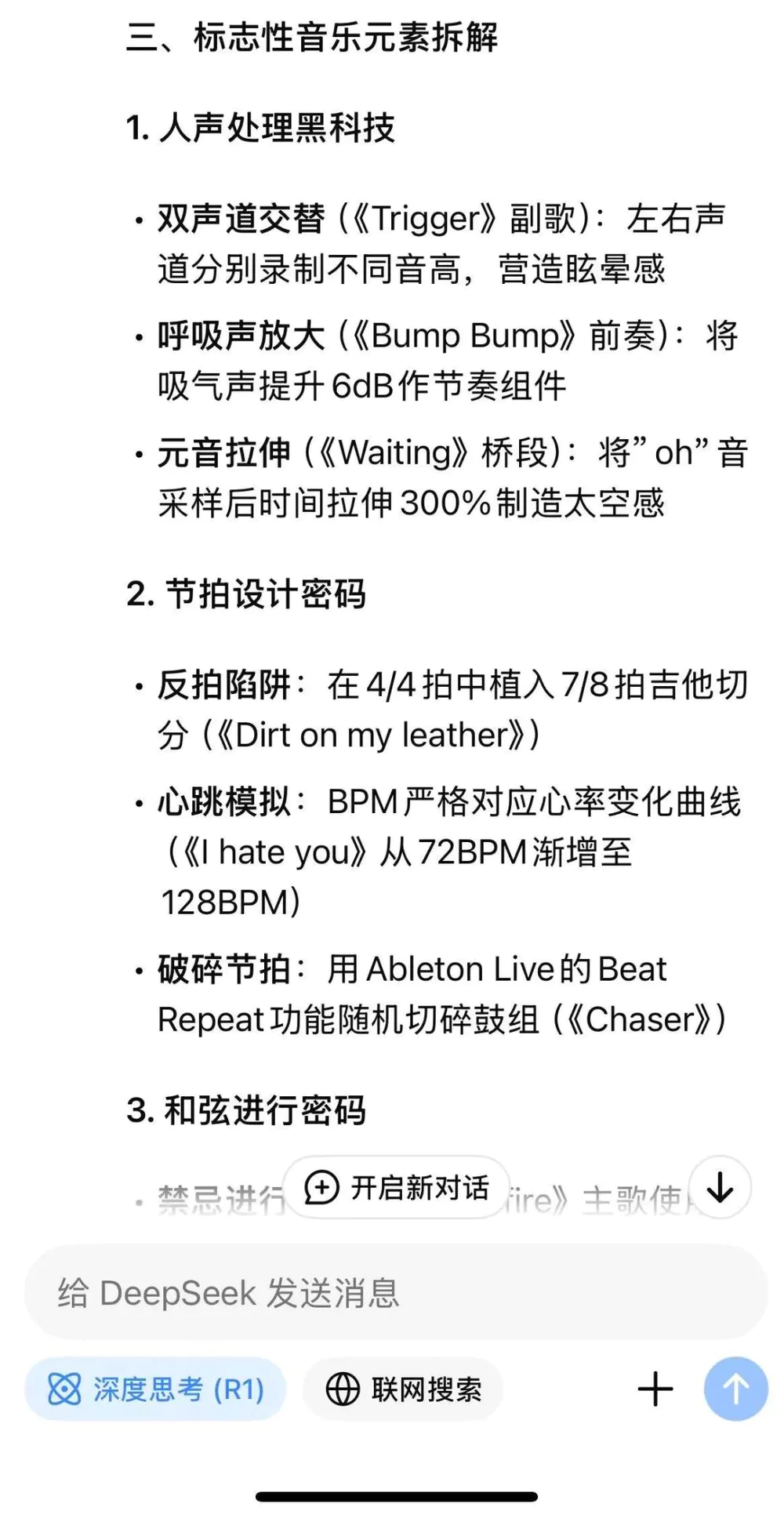

1. 人声处理黑科技

双声道交替(《Trigger》副歌):左右声道分别录制不同音高,营造眩晕感

这,我压根没听出这首歌里的左右声道有什么高八度低八度,而且不同音高本身根本不会制造眩晕感啊,如果要左右声道录double、通过音高作出区分,那是增强力道啊?眩晕感是通过混响、延迟整的啊?deepseek你在说啥呢?

呼吸声放大(《Bump Bump》前奏):将吸气声提升 6dB作节奏组件

这首歌前奏哪里有吸气声了……?吸气声提升6db做beat?不是哥们,这是什么玩意儿啊?就算我当你是有吸气声,但是“提升”肯定要有相对的吧,你是跟什么相对呢?你推大音量,你也要有“标准”对吧?这完全就是一个狗屁不通的描述啊?

元音拉伸(《Waiting》桥段):将“oh”音采样后时间拉伸 300%制造太空感

不是哥们,这首歌有bridge吗?桥在哪里?我连桥都找不到。

哦哦,说的是副歌后面的那个oh了一下的?这个真要说应该是“后副歌”,以及……这样采样拉伸300%,也是纯粹扯淡了。

好好好,下面还有:

2. 节拍设计密码

反拍陷阱:在 4/4拍中植入7/8拍吉他切分(《Dirt on my leather》)

Dirt on my leather这首歌确实是四四拍,确实也是走的rock band风格,有一把电吉他从头贯穿始终,但是7/8从何而来?这吉他弹的就是一个比较hard rock的,一直在弹call & response,节拍是一直跟着鼓组的,并没有任何复合节奏的意思。

心跳模拟:BPM严格对应心率变化曲线(《l hate you》从72BPM渐增至128BPM)

喂喂喂,这首歌从头到尾的速度都没有变化啊?BPM一直稳定在86左右啊,这心率曲线是怎么来的?

破碎节拍:用 Ableton Live的 Beat Repeat功能随机切碎鼓组(《Chaser》)

Live里面确实是有一个叫做Beat Repeat的功能,打开里面确实是能把鼓组切碎,但是这首chaser里面,鼓组一直都是非常稳定的啊?哪里碎了?

所以到了后面风格预测那些,大可笑笑罢了。

我确定了,红老师这是对我进行钓鱼,她就是希望以此摁头让我去听她家爱豆的歌,让我好好复习一下,然后让我去怼deepseek,让我给她说说,未来她的哥哥音乐会怎么走,她一定是在钓鱼。100%的。

总之,AI幻觉不是deepseek的问题,ChatGPT也一样跑火车,当然ChatGPT跑的程度会少一点(最新发布的o3貌似跑得离谱一些了),可deepseek的语言模型实在太真了,太言之确凿了,而且使用deepseek的门槛太低了,适用人数太多了,这里所造成的AI幻觉,确实是长城一般了。

如之前红老师给我发的这些,我当然可以说,一眼假,不信我打开歌曲听听,看看是不是都是扯淡——但是,如果讨论的是我不清楚的领域呢?我能否有这么轻松的方式去鉴定真伪?就像如今的小红书里,到处都是“我跟ds聊了聊XX”的内容,每次标题都很酷,我都点进去看了,结果又变着戏法再推给我这些玩意儿。AI确实是很强大的东西,但目前的AI有着巨大的技术缺陷,“颠覆了传统知识传播链条——专业论文→科普文章→网络内容”,你以为AI里面说的都是对的,尤其是它说出大量的专业词汇、超出你的学科认知的时候,其信息量之大,你几乎无从下手,无可辨别。

津公网安备12011002023007号

津公网安备12011002023007号