今年的诺奖将物理和化学两个领域的奖项都颁给了AI成果,这究竟代表着怎样的含义,又会产生怎样的影响?Demis Hassabis在本次专访中提出了自己的见解。

10月,DeepMind联合创始人兼CEO Demis Hassabis凭借AlphaFold成为了诺贝尔化学奖的三位共同获奖者之一。

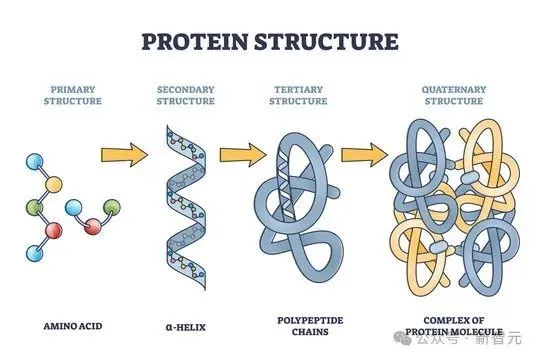

作为一种人工智能软件,AlphaFold解决了一个生物学界50年前提出的问题:预测每种已知蛋白质的结构。

事实上,AlphaFold这个极具开创性的模型,也仅仅是DeepMind成果的一部分。成立15年来,DeepMind已经跻身为全球最重要的AI实验室之一。

尽管被谷歌收购、与Google Brain合并后加入了一些商业考量,但他们目前仍然专注于科学和工程中最复杂和基本的问题,最终设计出能够模仿,甚至取代人类认知能力的强大AI。

获得诺奖后不到24小时,Demis Hassabis就接受了《金融时报》记者Madhumita Murgia的采访,讨论了DeepMind下一步将要解决的重大难题、AI对科学进步的作用,以及他本人对AGI之路的前景预测。

Demis Hassabis在谷歌DeepMind伦敦总部

AI4Science的下一个挑战

AlphaFold 3的相关进展,就一定程度上彰显了DeepMind在生物学领域下一步的前进方向——理解生物体内的相互作用,最终对整个通路进行建模,甚至可以构建出一个虚拟细胞。

此外,通过DeepMind子公司Isomorphic的努力,他们也在进军药物发现领域——设计全新的化合物、找到结合位置,并预测出这些物质的特性、吸收性、毒性等等。

目前,Isomorphic还与礼来、诺华等公司合作开展了6个药物研发计划,有望未来几年内在临床上有所进展,希望能大幅缩减药物发现所需时间,从而帮助治愈一些疾病。

除了生物学领域,Hassabis也表示对材料设计领域的工作感到十分兴奋。

去年,他们在Nature上发表的一篇论文提出了名为GNoME的AI工具,实现了AlphaFold 1级别的材料设计,共发现了220万个新晶体;下一步,就需要努力达到AlphaFold 2级别。

论文地址: https://www.nature.com/articles/s41586-023-06735-9

数学方面,AlphaProof和AlphaGeometry已经在今年达到了IMO银牌的水准,接下来的几年,DeepMind将尝试借助AI的力量真正解决一个重要的数学猜想。

对于能源和气候领域,去年在Science上发表的Graphcast模型能在1分钟内以前所未有的精度预测未来10天的天气。

论文地址:https://www.science.org/stoken/author-tokens/ST-1550/full

这其中的技术,或许可以帮助进行气候建模,这对于应对气候变化、优化电网等领域都非常重要。

可以看出,DeepMind的未来蓝图中,重点更多地放在应用和工程实践层面,旨在将技术进一步转化为能够影响现实世界的工作,而非纯粹的基础研究。

对此,Hassabis表示,「蛋白质折叠」是一个「可遇不可求」的「挑战」,不能要求每个问题都有如此含金量。

「蛋白质折叠」这个问题如此核心且重要,相当于生物学领域的费马大定理,但可惜的是,没有多少问题足够重要、探索时间足够长,能够被称之为「挑战」。

诺奖将成为AI的分水岭

今年的诺贝尔物理和化学奖项接连颁给AI学者,这很有趣,但谁也说不清评奖委员会为什么会做出这样的决定。

对此,Hassabis如何理解?

他表示,这很像是委员会特意发表的一种「声明」,也将成为AI的分水岭时刻,标志着它的技术成熟度得到了足够的认可,能够协助科学发现。

AlphaFold就是最好的例子,而Hinton和Hopfield的奖项则是针对更基础、更底层的算法工作。

Hassabis表示,希望10年后回顾当下时,AlphaFold将预示着所有这些不同领域的科学发现的新黄金时代。

这也带来了一个有趣的问题:有了AlphaFold这样的工具,科学家们不再需要花费过多的时间和精力来进行预测,这是否意味着我们应当去开拓新的领域?甚至改变学习科学概念的方式?

需要注意的是,AI系统是一类独特的新工具,它们具有一些内在的功能,因而不适用于传统意义上对工具的分类。

虽然AlphaFold等工具目前只能做到预测,但从某种意义上说,预测也是「理解」的一部分。如果你能预测,那就可以带来理解。

甚至,如果预测的输出足够重要,比如蛋白质的结构,那么它本身就是有价值的。

从更宏大的视角来看,科学中包含了很多层次的「抽象」。

比如,整个化学领域就是建立在物理学的基础上。你不需要理解量子力学等全部的物理原理,也可以谈论原子化合物,在化学自身的抽象层去理解它。

对生物学领域而言,我们可以研究生命,但仍然不知道生命是如何进化或出现的,甚至无法正确定义「生命」这个概念。

类似的,人工智能也像一个抽象层,构建程序和网络的人们在一定的物理层面上理解这一点,但随后产生的预测结果就像一种突然涌现的属性,我们可以在科学的层面上自行分析这些预测。

AGI迫近,理解很重要

无论是自然科学,还是人工智能系统,「理解」都很重要。

人工智能是一门工程学科,这意味着你必须先建造出一个系统,之后才能研究、理解这个对象;而自然科学中的现象不需要制造,是天然存在的。

虽然AI系统是工程化的人造物,但这并不意味着比自然现象更容易研究,甚至可以预期到的是,它会像生物神经网络一样难以理解、分拆和解构。

现在这种情况正在发生,但我们已经取得了一些进展,比如有一个专门的领域叫做「机械解释」(mechanistic interpretation),就是使用神经科学的观念和工具来分析AI系统这个「虚拟大脑 」。

对于AI的可解释性,Hassabis非常乐观,认为未来几年就会在理解AI系统这方面取得很大进展。

当然,AI也可以学着解释自己。想象一下将AlphaFold与语言能力系统结合起来,它就可以一边预测,一边解释自己在做什么。

目前,很多领先的实验室正在缩小他们的探索范围,专注于对Transformers进行扩展。不可否认,这是一个很好的方向,也将成为最终AGI系统的关键组成部分,但DeepMind会继续坚持探索和创新研究。

事实上,对于发明下一代Transformer而言,DeepMind拥有迄今为止最广泛、最深入的研究平台,这是他们科学遗产的一部分。

这些探索都是必要的,一部分原因是为了看看我们能走多远,这样就知道需要探索什么。

探索新想法,以及将令人兴奋的想法发挥到极致,这两条路都很重要。如果你不了解当前想法的绝对局限,也不会知道需要哪些突破。

LLM的长上下文窗口就是一个很好的例子。谷歌Gemini 1.5 Pro做出的2M token上下文就是一个很酷的创新,目前没有其他人能够复制。

谷歌DeepMind伦敦办公室

理解AI,才会有安全的AGI

Hassabis和很多科技领袖都曾预测,实现AGI还需要5~20年的时间。

如果要用科学方法实现这一目标,就意味着更多的时间、精力和思考,集中在AI的理解和分析工具、基准测试和评估上,需要目前投入的10倍。

这些投入不仅来自科技公司,还应包括AI安全机构,也来自学术界和民间社会。我们需要了解AI系统正在做什么、它们的局限性,以及如何控制和保护这些系统。

「理解」是科学方法的重要组成部分,却是纯工程中所缺少的。工程只是旁观——这个方法有效吗?如果不起作用就再试一次,充满了试验和误差。

科学则是在一切发生之前就能理解的东西。理想情况下,这种理解意味着更少的错误。这对于AI和AGI来说很重要,因为在运用一项如此强大的技术时,你希望尽可能少地犯错误。

也许几年后,当我们接近AGI时,就会出现一个社会问题——我们希望这些系统具有什么价值?我们要为它们设定什么样的目标?

这与技术问题不同。技术层面关注的是如何让系统走上正轨,朝着设定的目标前进,但并不能帮助我们决定目标应该是什么。

为了安全的AGI系统,技术问题和社会问题,这两件事都需要正确,但Hassabis认为,后者可能更难实现。

目标和价值观等一系列问题,会更多地涉及UN和地缘政治,甚至社会科学和哲学,需要与政府、学术界和民间社会各阶层进行广泛的讨论。

即使AGI还需要10年才能实现,我们解决这些问题的时间也并不是很多,因此这方面的讨论应该从现在开始,让各种来源、各种观点的声音呈现在桌面上。

津公网安备12011002023007号

津公网安备12011002023007号