图片来源:unsplash

从2009年阿里云写下飞天第一行代码,迄今已过去十五年,经历了互联网企业腾飞和传统企业深入数字化转型的两次云计算浪潮之后,眼下我们已经进入第三次浪潮:云与AI融合的新阶段。如同潮涌,AI的出现并不是颠覆前两次的产业逻辑,而是前期在云上的技术积累会在AI基础设施阶段加速释放平台价值。

下一个十五年,不难预期:云将是AI的后盾与燃料库。

这一点在网络的发展历程中也有迹可循。2000年前后,国内互联网刚兴起不久,是由运营商提供网络基础设施,人们的需求只是发发邮件、买买东西;当云计算与大数据到来,网络进入SDN时代,支撑网络游戏、直播、算法推荐的兴起;现在我们正经历AI智算时代,智能驾驶、LLM训练推理等,对网络的要求与过去更是截然不同。

如何能够匹配AI时代下超大规模算力需求,让性能极致发挥?阿里云已经有了答案。

为匹配AI时代的网络要求,阿里云去年研发出大规模集群架构HPN7.0,支持万卡集群式计算。据今年云栖大会最新公布,HPN7.0让模型端到端训练性能提升10%以上,目前它实行前后端网络分离技术,前端400G网络带宽提供高速存储访问和节点通信;后端3.2T GPU互联网络,可满足大规模AI计算需求。

实际上,阿里云早在2021年就在研究第一代万卡集群HPN6.0,当时主要满足自动驾驶客户对视觉模型训练的需求,彼时大模型还没有如此普及。此外,阿里云2022年10月在业内最早提出MaaS模型即服务理念,并引领了理念潮流。这些均表明,阿里云在AI底层和中间层AI infrastructure(简称“AI Infra”)方面一直保持着前瞻性思考与布局。

加法与减法的对碰

智能的迁跃在新能源汽车上表现尤为明显,其对智能基础设施的需求也更强烈。

在9月19日杭州云栖大会上,驾驶号称“全球首款AI汽车”P7+参会的小鹏汽车董事长何小鹏预测,端到端大模型对自动驾驶领域的价值在于,未来可以让每一个人在每一个城市都像老司机那样开车。

小鹏汽车董事长何小鹏

在常规理念中,代码富集意味着功能强大,但通过端到端(End-to-End)的神经网络代码建立了感知—决策—执行一体化,把这三步骤集合在同一个大模型中去做,彻底改变了过去的串联式架构。实际效果是:端到端“绕开”了地图数据,可根据摄像头、传感器实时采集的图像数据,直接生成车辆的加速、转向、刹车信号,让汽车反应更顺滑。

在此背景下,代码将进一步缩减。以特斯拉FSD v12.5.1版本为例,原本30多万行的C++代码砍到只剩下3000行。但与此同时,马斯克从英伟达手里又团购了35万张显卡,以支持更快的数据处理。算力做加法,这也是让前端能逐渐变得更加简洁的基础前提。

过去两年,小鹏汽车也一直在加码算力,其与阿里云共建的智算中心的算力储备扩张超4倍至2.51Eflops,以前需要一周完成的自动驾驶大模型训练,如今通过智算中心可以缩短到用一小时完成。为加速端到端大模型、提升自动驾驶的上限,何小鹏表示将继续深化与阿里云的AI算力合作,预计每年投入35亿元用于研发,其中7亿元划拨给算力训练,并加速端到端大模型的落地。

小鹏汽车从2015年在阿里云开户,2019年车联网研发上云,到2022年与阿里云在乌兰察布建成自动驾驶智算中心,再到自主研发的“全域大语言模型”X-GPT与阿里云通义千问的融合,全面智能化升级车载助理;此外,小鹏汽车还积极拥抱阿里云通义万相,并在研发领域引入通义灵码,实现代码评审效率的大幅提升……这家车企现已All in AI,在制造、车联网、自动驾驶、智能座舱、官网数字营销多个领域与阿里云资源深度绑定。

另一家车企吉利也在智驾的路上飞奔,其与阿里云已合作9年之久,通过采用混合云架构,线下专有云部署1000台服务器+20P存储、线上7万核公共云ECS+28P存储。在智能驾驶场景,吉利使用了飞天专有云、标杆算力平台PAI灵骏+OSS+大数据+数据库;智能座舱则通过阿里云的EGS+DeepGPU加速引擎,将吉利自研大模型推理上云,加速效果提升40%,并调用通义大模型API接口。同时它借助通义万相VL功能,支持智能座舱舱外识物,利用通义千问Plus,支持客户情感闲聊。

图片来源:unsplash

据行业内测算,传统燃油车有大约3万个零部件、整车芯片大约有500颗;而新能源AI汽车的零件只有不到2万个,芯片量却达5500颗左右。一加一减之间,汽车的交互方式与生产逻辑已被改变,对专有芯片、大规模算力集群和云原生数据库的依赖进一步增强。

据最新消息,英伟达广泛覆盖汽车领域的NVIDIA DRIVE Orin系统级芯片,已实现与阿里云通义千问多模态大模型Qwen2-VL的深度适配,并应用于斑马智行的智能座舱场景中。大模型接入汽车座舱,拓展人机交互边界,已成趋势。

“万卡时代”的全栈创新

大模型虽火,但并不算成熟。市面上的大模型几乎每天都会因各种错误造成训练中断,而训练时效对业务创新具有决定性意义,训练太慢、总是中断,创新效率就难以提升。人们往往添加更多的GPU来增强训练时效。像Meta训练Llama模型时用的是1.6万卡算力集群,大概每隔两三个小时整个训练任务就要重新开始,回到上一个Checkpoint。

从128张卡到1024张卡,从千卡到万卡,再到十万卡,“万卡堆叠”在理论上看似简单,单个GPU算力乘以GPU规模即构成整体算力。然而在实际运行中,当卡的规模急剧扩大时,很难再保证这种理论上的线性比,会产生算力“衰减”,这些都是运营难点。

这时候,网络在这个集群中发挥着重要的作用,因为网络在“梯度同步”过程中需要时间,且需大量数据交换,这个时间长短直接决定了GPU在计算过程中的等待时间,导致传统网络集群不再适用于AI计算。

对此,上面提到的阿里云HPN7.0高性能网络架构提出了一个创新性设计,它采用单层千卡、两层万卡、存算分离的架构,专门为AI计算所设计,支持十万卡集群。两层网络不仅减少了时延,还简化了网络连接的数量和拓扑,从而找到了最优解。

阿里云过往长期积累的规模优势也正支撑着新一轮技术优势——此次云栖大会上最新发布的 Qwen2.5–72B 性能超越 Llama 3.1 405B,同时模型算力成本再次下降,通义千问三款主力模型最高降幅 85%。AI基础设施必然会更强大,不仅要走得好,也要走得起,由此才能推动更多创新,在这一方向上阿里云也在加速。

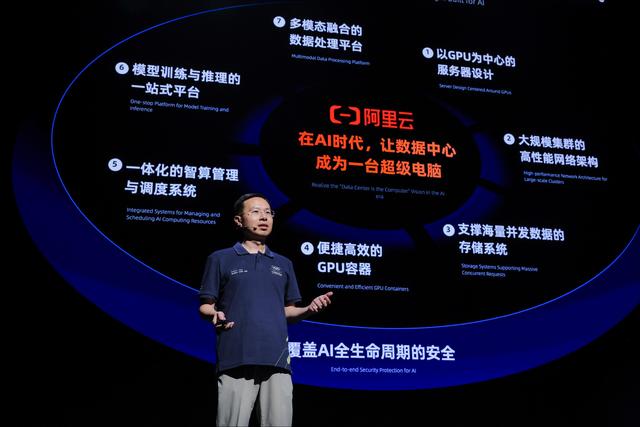

在阿里云CTO周靖人看来,AI技术变革触达了计算机体系的方方面面,需要对全栈进行全方位的创新。不仅是网络,还包括服务器、存储、数据处理、模型训练和推理平台的技术架构体系,都需要围绕AI做全面升级,“阿里云正在围绕AI时代,树立一个AI基础设施的新标准。”

阿里云CTO周靖人

阿里巴巴集团CEO、阿里云智能集团董事长兼CEO吴泳铭在云栖大会上分享,过去一年阿里云投资新建了大量的AI算力,但还是远远不能满足客户的旺盛需求。这更坚定了阿里云未来的投资力度。

具体看,在服务器端,阿里云最新上线的磐久AI服务器支持单机16卡GPU、共享显存1.5TB,并提供基于AI算法的GPU故障预测,准确率达92%。AI时代将从CPU核心过渡到以GPU为主的计算实例,需要支持全球各地的异构芯片,面对比CPU时代更多的架构创新,磐久服务器就是专为AI深度优化,在芯片的快速适配、散热上做了优化处理。

在存储上,阿里云CPFS文件存储在经历过去一年发展已变成一项全托管服务,免去客户运维工作。它目前扩容到了每秒高达20TB的带宽,在设计上采用了存储的梯度架构,可把热度最高的数据放在延迟最低的存储上。其中CPFS与统一存储数据湖OSS之间的数据传输速度达到每秒100GB。这些设计都是为AI智算设计。

以上包括磐久AI服务器、HPN网络、CPFS存储,再加上容器服务ACS,一起构成了阿里云AI算力平台灵骏,在AI Infra层面打造出一个更适合GPU计算和AI模型训练的基础设施。阿里云与复旦大学共建的云上智算平台CFFF、与小鹏汽车在乌兰察布共建的自动驾驶智算中心,都属于灵骏的产业端应用。

目前,以AI开发和应用落地的全栈能力可以通过PAI和阿里云百炼这两个平台对外落地。在云栖大会上,两者均有新的服务升级发布:PAI模型训练全面提升了稳定性,千卡规模集群故障分钟级自动发现,覆盖故障达98.6%;百炼2.0专属版本在云栖大会上发布,专门针对政企客户做了使用优化。

正是由于以上种种创新使得通用大模型及基础算力迎来多轮降价,降低了企业AI开发成本,对于各行业AI渗透率的提升至关重要。

回顾早期云计算,因托管层级的不同被分为IaaS、PaaS、SaaS层。现在这个架构因AI向上延伸至MaaS开源,向下延伸到芯片层、异构算力。AI不仅拓展了云的边界,也激励云再做一次物理级别的全栈升级变革。如今,真正到了检验云厂商创新能力的时候。

下一个十五年, “AI+云”的基础设施之上,新的浪潮奔涌而来。

津公网安备12011002023007号

津公网安备12011002023007号