12日,据媒体援引知情人士透露,生成式AI领头羊OpenAI正开发新的AI大模型项目——“草莓”(Strawberry),而这个“草莓”非常神秘,很可能与提升AI大模型的推理能力有关。

OpenAI的神秘项目“草莓”是什么?

据媒体报道,5月份OpenAI的一份内部文件显示,OpenAI的内部团队正开发的“草莓”项目,目的是增强OpenAI的模型的推理能力,处理复杂科学和数学问题的能力,让大模型不仅能生成查询答案,还能提前规划,以便自主、可靠地浏览互联网,进行OpenAI 定义的“深度研究”。

按照十几位人工智能研究人员的说法,这是目前大语言模型还没能实现的功能。

很明显OpenAI现阶段还不想公布关于“草莓”的详细资料。

当被问及“草莓”的细节时,OpenAI的一位发言人只是绕了个弯表示:“我们希望AI大模型能像人类那样看待和理解这个世界。不断研究新的AI能力是业界的普遍做法,毕竟我们都相信AI的推理能力会随着时间的推移而不断提高。”

毕竟即便在 OpenAI 内部,“草莓”的工作原理也是严格保密的,目前仍没有“草莓”的发布时间消息。

但有媒体透露,“草莓”项目的前身是Q*算法模型,Q*能够解决棘手的科学和数学问题。而数学是生成式AI发展的基础,如果AI模型掌握了数学能力,将拥有更强的推理能力,甚至与人类智能相媲美。而这一点也是目前的大语言模型还无法做到的。

去年底Q*在OpenAI的内部信中首次曝光,而CEO奥特曼当时被开除也是因为这个Q*项目。

一些OpenAI内部人士指出,Q*可能是 OpenAI 在追寻通用人工智能(AGI)路上的一项突破,其发展速度之快让人感到震惊,并担心AI过快发展可能会威胁到人类安全。在这种担忧蔓延之际,奥特曼在没有告知董事会的情况下,选择加速推进GPT系列模型的开发及商业化,这激发了OpenAI董事会的不满并选择把他踢出局。

OpenAI的野心:利用“草莓”提高大模型的推理能力

虽然无法获取“草莓”的详细情况,但从OpenAI近期的种种蛛丝马迹中可以发现,增强生成式AI大模型的推理能力,是它接下来的发展重心。

OpenAI的CEO奥特曼曾强调,今后AI发展的关键将围绕推理能力展开。

在本周二的一次内部全员会议上,OpenAI展示了一个研究项目的演示,称该项目拥有类似人类的推理能力。OpenAI发言人向媒体证实了这次内部会议,但拒绝透露会议细节,因此无法确定演示的项目是否为“草莓”。

但据知情人士透露,“草莓”项目包括一种专门的“后训练”方法,即生成式AI模型已经过大量数据集上进行预训练后,进一步调整模型以提高其在特定任务上的表现。这类似于斯坦福大学在2022年开发的“自学推理者”(Self-Taught Reasoner,简称STaR)方法。

STaR的创造者之一、斯坦福大学教授Noah Goodman曾表示,STaR可以让AI模型通过反复创建自己的训练数据,“引导 ”自己进入更高的智能水平,理论上可以用来让语言模型实现超越人类的智能。

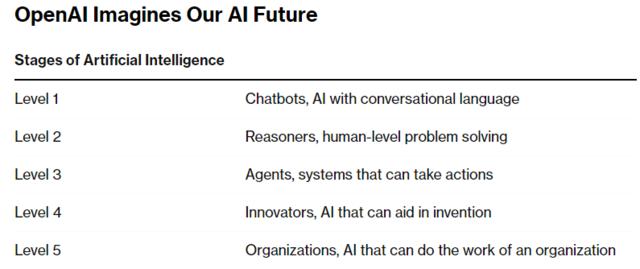

这就和OpenAI想要的“推理能力”对上了号。而且,OpenAI在11日还公布了未来AI发展的五级路线图:

按照OpenAI的猜想,未来AI会经历5个阶段:

第一级:聊天机器人,具有对话语言的人工智能

第二级:推理者,人类水平的问题解决

第三级:代理者,可以采取行动的系统

第四级:创新者、可协助发明的人工智能

第五级:组织者,可以完成组织工作的人工智能

按照目前搜集的信息,“草莓”项目极可能是帮助OpenAI实现第二级AI的关键。

据媒体报道,一位OpenAI高管表示,目前AI模型正处第一级别,但预计很快将达到第二级别,即推理者。OpenAI目前正在致力于在特定任务上实现博士级别的智能,预计可能在一年或一年半内实现。

另一项OpenAI聚焦的功能是,提高大语言模型执行长时间任务(Long-Horizon Tasks,简称LHT)的能力,这指的是需要模型提前规划,并在较长一段时间内执行一系列任务。

据知情人士透露,为了实现这一目标,OpenAI希望“草莓”能成为创建、训练和评估“深度研究”的模型,并利用“计算机使用代理”(Computer-Using Agent,简称CUA)来自主浏览网页,并根据其发现自主采取行动。

如果OpenAI成功了,“草莓”项目很可能会重新定义AI的能力,使其能够进行重大科学发现、开发新的软件应用程序,并自主执行复杂任务,那人类离AGI又进一步了。

津公网安备12011002023007号

津公网安备12011002023007号