自2023年开始,全球范围掀起了以大模型为代表的生成式AI浪潮。过去一年,但凡和算力、算法、数据、网络安全、云计算、AI相关的企业和题材,都在AI大模型题材的风口上,被追捧上了天。但从技术革新的角度看,国产大模型并没有给生产生活方式带来质的改变。

前不久,李开复在一场采访中直言不讳地指出,对于美国人来说,“ChatGPT时刻”发生在17个月前,但中国用户却还在翘首以待属于自己的“AI时刻”。

与此同时,不断有大佬高喊“不能落地的大模型没有意义”。

比如李彦宏就公开表示,中国现在数百个基础模型是对社会资源巨大的浪费,更多的资源应该如何探索与各行各业的结合,以及下一个超级应用的可能性。

在需求端,市场其实非常迫切想要找到能快速落地、产生效益的AI产品和服务。对于大模型开发者和应用者来说,卷参数已经没有任何意义。在火山引擎总裁谭待看来,“如何让更多人、各行各业用起来”,才是现阶段对于“好模型”的最佳定义。

多位行业人士判断,今年将是中国生成式AI应用的爆发元年。而当下打开市场的关键突破口,“价格”成为了行业的新共识。

用起来是关键

在当前市场上,大模型通常是以1000 tokens为计费单元。以GPT4为例,从去年3月发布至今,OpenAI把GPT4升级到GPT-4o,输入价格从0.03美元/1000 tokens下降到0.005美元/1000 tokens,降幅高达83%;输出价格也从0.06美元/1000 tokens下降到0.015美元/1000 tokens,降幅为75%。

按照OpenAI的预期,其大模型将按照每年50-75%幅度继续降本。

把降本深埋在业务发展主线的,不只有OpenAI。今年以来,为了加速应用端的落地,国内大模型玩家不仅开始顺应降价的趋势,甚至降幅力度达到了惊人的程度。

例如智谱大模型在本月官宣其新的价格体系,入门级产品 GLM-3 Turbo 模型调用价格从 5 元/百万 tokens 降至 1 元/百万 tokens,降幅高达 80%。

再比如DeepSeek 在5 月 6 日发布的二代 MoE 大模型 DeepSeek-V2,能力对标GPT-4、llama 3-70B,每百万 tokens 的输入和输出分别是 1 元和2 元,只有 GPT-4 Turbo 价格的近百分之一。

而字节在5月15日发布的豆包大模型,直接把AI使用成本从“以分为单位”,干到了“以厘为单位”的时代。

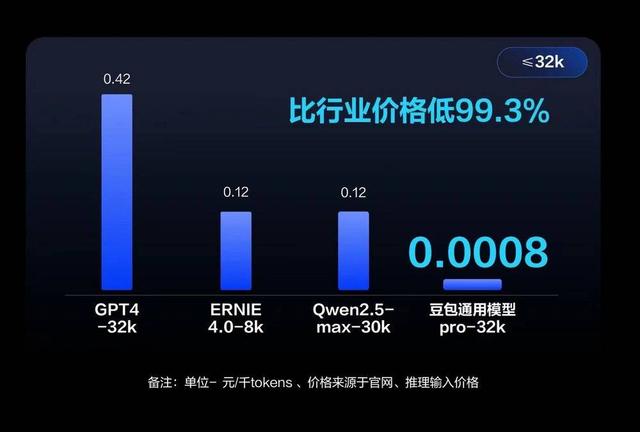

其中,主力模型豆包Pro 32k定价0.8厘/1000 tokens,比行业平均价格降低99.3%。在全行业降价的背景下,同样是1块钱,用户可以从GPT买到2400个 token,国产大模型可以得到8000多个 token。

如果用户用开源Llama模型自己搭建,大概能获得3万个 token。而1块钱,能在豆包大模型上足足获得125万个 token,相当于处理3本75万字的《三国演义》文字量。

在过去一年上演的“百模大战”,每隔一段时间总会有人对“如何加速模型落地”进行追问。无可否认,AI大模型有无限大的价值,等着市场玩家去发掘,但眼下不过是行业非常初期的探索阶段。

AI作为一场成本驱动的生产力革命,大模型的价值在于通过创建图像和语言理解,让创造的边际成本无限趋近于零。在火山引擎总裁谭待看来,降价是价值创造的重要推动力:“大模型在 to B市场的应用场景还很少,包括OpenAI也在不断降价,大家的共同目标都是把市场蛋糕先做大。”只有降低客户试错成本,才能促进产业繁荣。

一位行业人士坦言,目前中国AI大模型应用的市场规模,与所有市场玩家投入的训练成本相比杯水车薪。企业还无法靠 to B 服务做到正循环,在收入方面的差距在两个量级以上。在这种情况下,大模型企业试图通过降价,让更多人用起来,“至少是条可以尝试的路子。”

低价而非价格战

中国企业历来奉行应用主义,多数企业之所以愿意拥抱AI时代,就是希望自身在市场竞争中借助 AI 打造差异化优势,从而提升行业竞争力。

然而,面对市场层出不穷的大模型,用户难以准确做出选型决策。再加上企业缺乏模型调优和专业数据处理的经验,导致模型的实际应用效果达不到预期,很难与自身业务相适配。

模型效果是AI落地最关键的一环。多位行业从业者表示,好的技术一定是在大规模应用,不断打磨的情况下形成的。这与字节在豆包大模型发布会上对外阐述的理念一致——用起来才是关键。“只有在真实场景中落地,用的人越多,调用量越大,才能让模型越来越好。”谭待告诉虎嗅。

通常来说,价格是用户对于大模型的首要考虑因素。毕竟AI 创新的风险系数非常高,很多企业即使想做各种创新,可受限于模型使用成本,并且担心模型难以胜任各垂类场景的任务,导致ROI为负,因此会更倾向尝试没有门槛负担的工具。

谭待粗略算了一笔账,企业要想用AI做一项创新,至少要消耗100亿 token,如果按照大模型之前的售价,平均需要花费80万元,而现在使用豆包大模型,只需要8000元就能搞定。

过去,大模型推理成本下降,很大程度上依赖于算力的升级。而豆包之所以在价格上“碾压”其他同类大模型,依靠的是模型结构的优化、工程上从传统的单机推理变为分布式推理,以及把不同负载的推理进行混合调度等方式,从而带来超预期的降本效果,也成为打开AI应用的重要“开关”。

值得注意的是,包括BATJ等头部大厂,也都在把大模型的竞争焦点放在了模型训练效率提升,降低大模型的推理成本上。

当然,如果单纯拼价格,谁都能祭出价格更低的大模型。但如果要真正打破大模型与行业之间的高墙,让美好的场景更广泛地发生,更低的成本是必要条件,但不能以牺牲模型的质量为前提。

例如市面上也有很多轻量化模型,虽然也做到了比较低的成本,但是以压缩了模型能力和推理成本为代价,在效果上大打折扣,不能与其主力模型相提并论。

尽管大模型降价的趋势已成必然,但字节的“行业最低价”也招致不小的热议。

一方认为,豆包大模型以行业最低价让企业用最低成本就能调用大模型,加速了应用落地;另一方则批评,字节的野心让其过早地触发了价格战,随着各家大模型使用成本逐步降低,接下来很可能会上演一场市场争夺战。

对于外界的质疑,谭待解释称,大模型现在还是初期阶段,远没有到激烈竞争的程度,模型的推理成本未来一定会继续下降,“或许,等到那时再回看今天的0.8厘钱,也许一点都不便宜。相比之下,我们只不过是提前那么一步而已,目的并非是为了驱赶对手。”

况且,低价不等同于“价格战”。to B 需要保持长期的盈利,谭待表示:“不亏损是保障业务稳定的关键,也是火山引擎的原则。”因为只有这样,才能长期可持续地提供服务。

从概念验证迈向落地开花

在去年AI大爆发引发的大模型训练热潮中,包括智谱AI、月之暗面、Minimax、零一万物最早都使用了火山引擎的算力训练模型。

谭待坦言,云市场其实比拼的就是规模。AI大模型的火热,为云厂商开辟了新的市场机遇。微软Azure就是最有力的证明。其通过投资绑定OpenAI让云业务一路高歌猛进,跃升为全球第一的智能云。

目前,豆包大模型已通过火山引擎正式对外提供服务。根据官方数据,豆包大模型单日Tokens的用量达1200亿,单日生成的图片数超过了3000万张。

去年,当大多数在去年上演“百模大战”时,字节的“缺席”曾一度被外界认为存在严重的滞后性。彼时的豆包大模型,还处于襁褓之中。谁曾想,隐忍多时的字节,会在这个节点出手。

除了模型的效果和成本,应用落地也非常关键。在过去一年里,豆包接入了包括抖音、头条、番茄小说等50多个业务,业务场景涵盖办公智能助手、电商导购、售后客服、营销创作、数据智能分析、编程助手等,并邀请了手机、汽车、金融、消费、互娱领域的行业头部客户内测。

在模型打磨的过程中,挑战一直都在。首先要让基础能力和性能达到对应的标准,然后对接企业客户需要解决很多问题,比如搭建大模型评估和应用流程,包括测试集合、案例分析和精调能力等,否则很难辨别哪些场景靠谱,哪些场景短期内不合适。

也是在和企业客户磨合的过程中,火山引擎团队加深了对助手类、知识类、娱乐类、教育类等场景的了解和适配程度,并且针对不同场景在火山方舟2.0平台植入了对应的插件和工具平台,不断实践摸索中找到最佳的解决方案。

大模型的能力目前很多维度上让人惊叹,但也有很多缺陷,同时又在快速演进,每隔三个月、半年都会发生很大变化。“这恰恰是做大模型产品的挑战和乐趣,需要在这种持续动态的技术发展中,不断去判断下一个产品的PMF (产品市场匹配点)可能是什么。”

值得一提的是,在字节的AI 应用搭建平台“扣子”上,已经有些开发者通过自己开发的应用,获得了一定收入。谭待预测在今年下半年,大模型在应用方面将会让更多场景,从概念验证阶段走向落地阶段。

眼下,火山引擎和招商银行、蒙牛、OPPO等企业用户,在核心业务场景都已展开了合作和探索,至于大模型将如何塑造未来,一切还要交给时间去验证。

津公网安备12011002023007号

津公网安备12011002023007号