知名学术期刊Science宣布改变使用生成式人工智能和大型语言模型的政策,如果技术使用得到承认和解释,将允许作者将人工智能编写的文本和图形合并到论文中。

*图源Science

*图源Science

昨日Science发布了关于改变使用生成式人工智能和大型语言模型的政策。Science系列期刊的更新的政策是,只要方法部分出现适当的披露,在研究中使用这些人工智能的工具是可以接受的。

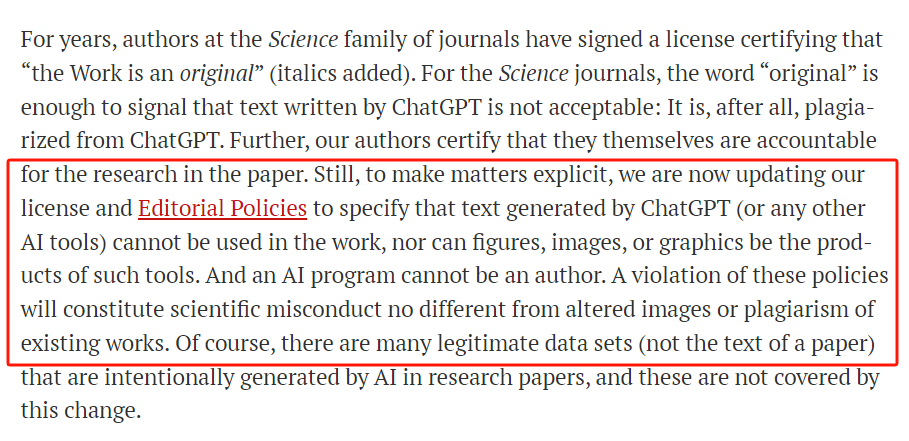

在此之前,Science明确规定作品中不能使用由 ChatGPT(或任何其他人工智能工具)生成的文本,数字、图像或图形也不能是此类工具的产物。违反这些政策将构成科学不端行为,与篡改图像或剽窃现有作品没有区别。

*Science于2023年1月发布的政策提到禁止使用AI工具

*Science于2023年1月发布的政策提到禁止使用AI工具

但现在,Science放松了对ChatGPT等AI工具的限制,调整政策包括以下内容:

· 人工智能辅助技术(如大型语言模型(LLM)、聊天机器人和图像创建器)不符合《Science》期刊的作者标准,因此不得列为作者或共同作者,内容中引用的资料也不得由人工智能工具撰写或共同撰写。

· 作者如果将人工智能辅助技术作为其研究的组成部分,或作为撰写或发表稿件的辅助工具,应在求职信和稿件致谢部分注明。详细信息应在方法部分提供: 应表明作品制作过程中使用的完整提示以及人工智能工具及其版本。

· 作者应对作品的准确性负责,并确保没有抄袭行为。他们还必须确保适当引用所有资料来源,并应仔细审阅作品,防止人工智能可能带来的偏见。

· 如果人工智能使用不当,编辑可能会拒绝继续处理稿件。审稿人不得使用人工智能技术生成或撰写审稿意见,因为这可能会破坏稿件的保密性。

· 未经编辑明确许可,《Science》期刊不允许使用人工智能生成的图像和其他多媒体。在某些情况下可能会有例外,例如在专门涉及人工智能和/或机器学习的稿件中使用图像和/或视频。此类例外将逐案评估,并应在投稿时标明。

多个学术组织政策发生变化

不止是Science,还有多个学术组织都在改变对人工智能使用方面的政策。

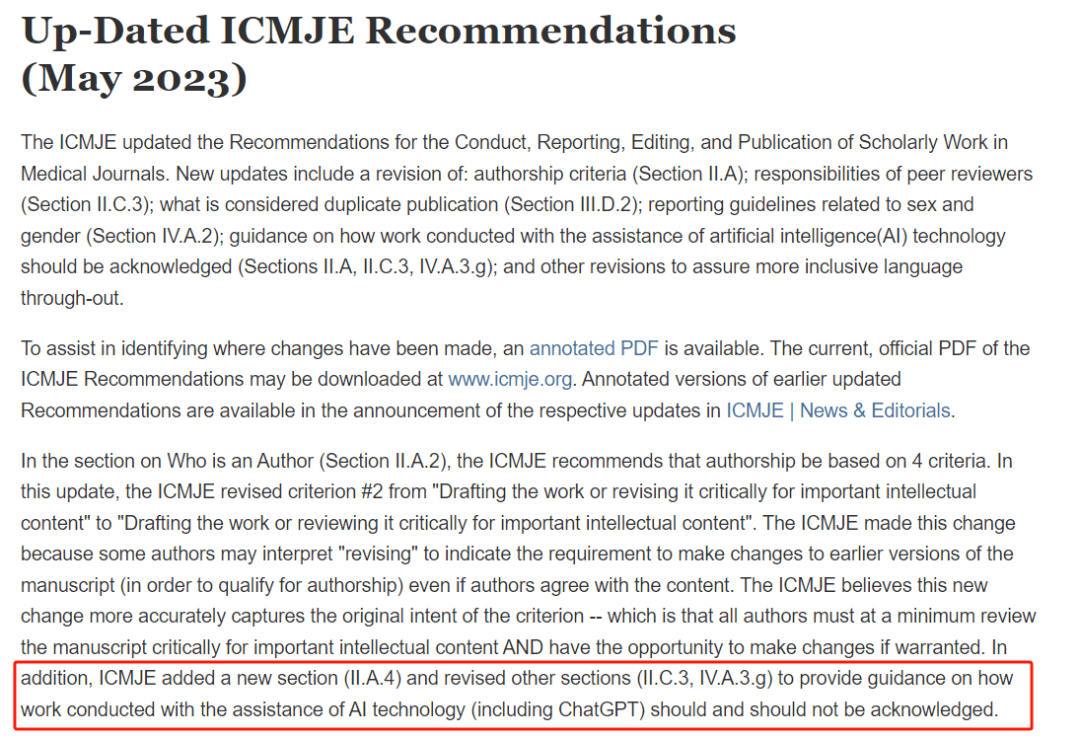

· 国际医学期刊编辑委员会(ICMJE)更新了医学期刊学术工作的实施、报告、编辑和出版的建议,其中就包括指导如何在人工智能技术(包括ChatGPT)的帮助下开展工作)。

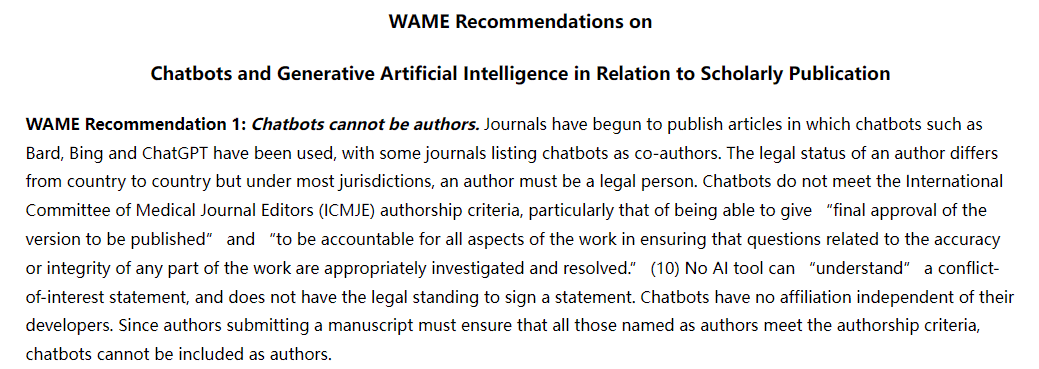

·世界医学编辑协会(WAME)发布的关于与学术出版物相关的聊天机器人和生成人工智能的建议。

· 科学编辑委员会(CSE)发布的机器学习和人工智能工具指南。

《Science》表示他们意识到人工智能领域正在迅速发展,他们对人工智能生成多媒体的立场可能也会随着版权法和道德使用行业标准的发展而改变。

他们也表明会持续关注这一充满挑战的趋势,并根据需求谨慎调整。

小E提醒大家,不管是要发表期刊还是完成学校的论文作业,如果打算使用人工智能工具来帮助自己,那就一定要确认好这些工具使用的准则,以免出现学术剽窃的问题哦!

津公网安备12011002023007号

津公网安备12011002023007号